Ollama: Ejecuta Modelos de Lenguaje Grandes Localmente

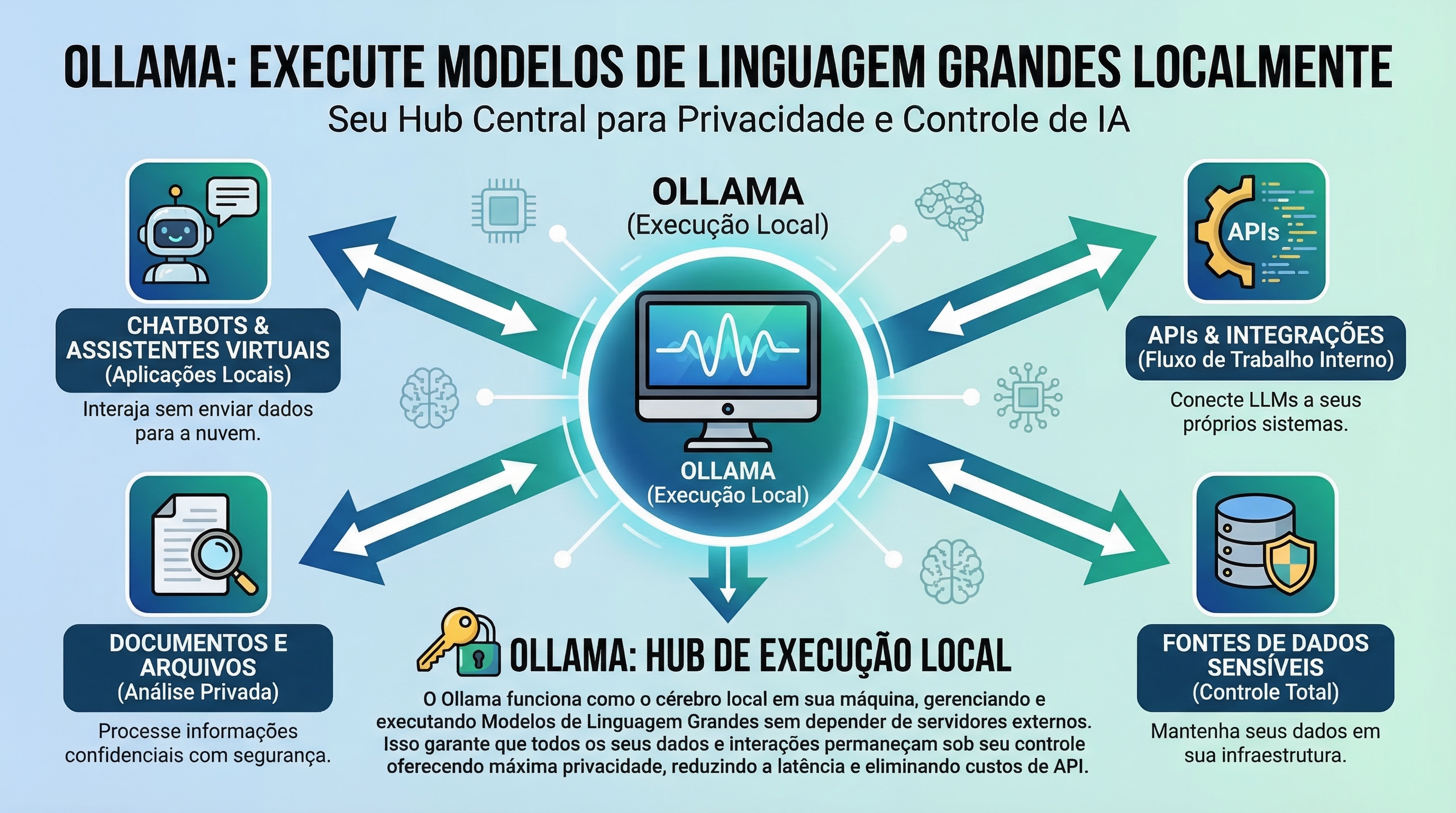

Ollama es una herramienta de código abierto que permite ejecutar modelos de lenguaje grandes directamente en tu máquina local, garantizando privacidad, control total y eliminando la dependencia de servicios externos.

Ollama: Ejecuta Modelos de Lenguaje Grandes Localmente

15 de marzo de 2026

La creciente popularidad de los modelos de lenguaje grandes (LLMs) como GPT-3 ha abierto nuevas posibilidades para la automatización y la inteligencia artificial. Sin embargo, el acceso a estos modelos frecuentemente depende de APIs de pago y de la necesidad de enviar datos a servidores externos, planteando preocupaciones sobre privacidad y costos. Ollama surge como una solución prometedora, permitiendo que ejecutes LLMs directamente en tu máquina local, ofreciendo control total y eliminando la dependencia de servicios de terceros.

¿Qué es Ollama y Por Qué Usarlo?

Ollama es una herramienta de código abierto que simplifica el proceso de descarga, configuración y ejecución de LLMs en tu computadora. Abstrae la complejidad de la gestión de dependencias y configuraciones, proporcionando una interfaz de línea de comandos intuitiva para interactuar con los modelos. Al ejecutar LLMs localmente, garantizas que tus datos permanezcan privados, evitas costos de API y obtienes mayor flexibilidad para personalizar y adaptar los modelos a tus necesidades. Esto abre puertas para diversas aplicaciones, desde desarrollo de chatbots y asistentes virtuales hasta tareas de generación de texto y análisis de datos.

Instalando y Configurando Ollama

La instalación de Ollama es un proceso simple y directo. Está disponible para macOS, Linux y Windows (vía WSL2). El sitio oficial (https://ollama.com/) proporciona instrucciones detalladas para cada sistema operativo. Después de la instalación, puedes comenzar a usar Ollama inmediatamente, sin necesidad de configurar variables de entorno o instalar dependencias adicionales. La herramienta se encarga de manejar todos los detalles técnicos, permitiéndote concentrarte en el uso de los modelos.

Descargando y Gestionando Modelos

Ollama ofrece un catálogo creciente de modelos preentrenados, que pueden ser descargados y ejecutados con un único comando. Para listar los modelos disponibles, usa el comando ollama pull. También puedes buscar modelos específicos usando el comando ollama pull <nombre_del_modelo>. Después de la descarga, el modelo estará disponible para uso inmediato. Ollama gestiona automáticamente el almacenamiento y la versión de los modelos, facilitando la actualización y el cambio entre diferentes opciones. Es importante notar que el tamaño de los modelos puede variar significativamente, así que asegúrate de tener suficiente espacio de almacenamiento en tu disco.

Si estás buscando explorar el poder de la IA para optimizar tus operaciones, considera las soluciones que Toolzz AI tiene para ofrecer.

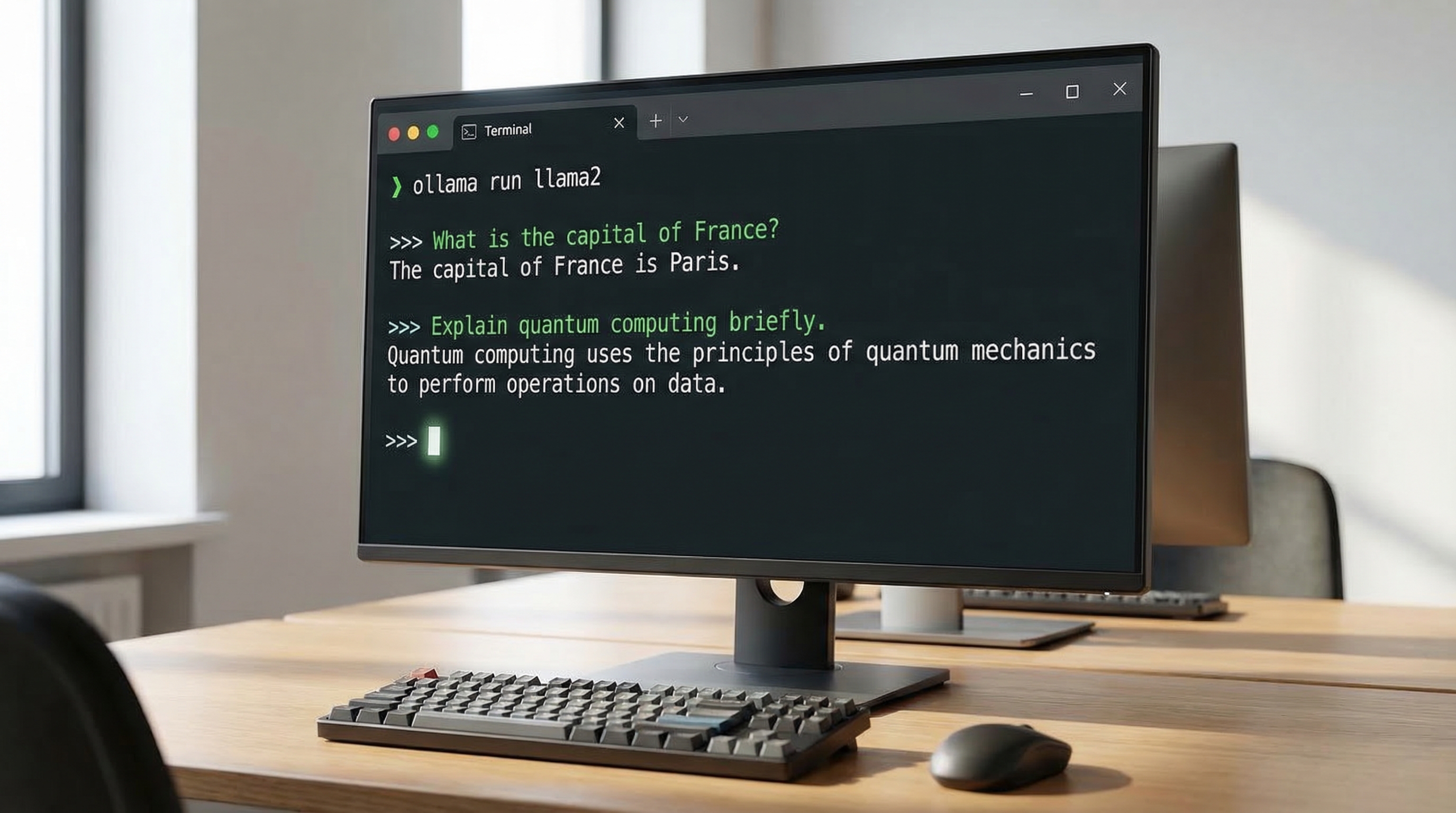

Interactuando con LLMs en la Terminal

Una vez que el modelo esté descargado, puedes comenzar a interactuar con él directamente en la terminal. El comando ollama run <nombre_del_modelo> inicia una sesión interactiva, donde puedes insertar prompts y recibir respuestas del modelo. Ollama se encarga de manejar la comunicación y el procesamiento, presentando las respuestas de forma clara y organizada. Puedes usar esta interfaz para probar diferentes prompts, explorar las capacidades del modelo y ajustar los parámetros para obtener los resultados deseados. La simplicidad de la interfaz de línea de comandos hace que Ollama sea accesible incluso para usuarios sin experiencia en programación.

Integrando Ollama con Herramientas de Desarrollo

Ollama puede ser fácilmente integrado con herramientas de desarrollo, como editores de código e IDEs. Esto permite que aproveches los LLMs en tus proyectos de software, automatizando tareas como generación de código, documentación y pruebas. La herramienta ofrece APIs y bibliotecas que facilitan la comunicación con los modelos, permitiéndote crear aplicaciones personalizadas y flujos de trabajo automatizados. Además, Ollama puede ser usado en conjunto con otras herramientas de IA, como frameworks de aprendizaje automático y bibliotecas de procesamiento de lenguaje natural, expandiendo aún más sus capacidades.

¡Automatiza tus tareas con IA! Solicita una demostración de Toolzz AI y descubre cómo podemos transformar tus procesos.

Ollama y el Futuro de la IA Local

Ollama representa un paso importante hacia un futuro donde la inteligencia artificial es más accesible, privada y personalizable. Al permitir que los usuarios ejecuten LLMs localmente, democratiza el acceso a esta tecnología poderosa y capacita a los desarrolladores para crear aplicaciones innovadoras sin depender de servicios de terceros. Combinado con la capacidad de personalización ofrecida por plataformas como Toolzz AI, que permite la creación de agentes de IA personalizados, Ollama abre nuevas posibilidades para automatización e inteligencia artificial en empresas de todos los tamaños. Al reducir la dependencia de APIs externas, Ollama también contribuye a la creación de soluciones más resilientes y seguras.

En resumen, Ollama es una herramienta poderosa y versátil que simplifica el proceso de ejecución de LLMs localmente, garantizando privacidad, eliminando costos y abriendo nuevas posibilidades para automatización e inteligencia artificial. Si buscas una forma de experimentar e integrar LLMs en tus proyectos, Ollama es una excelente opción.