Armadilhas de Agentes de IA: Riscos e Como se Proteger

Descubra as vulnerabilidades em agentes de IA e aprenda a proteger sua empresa contra ataques.

Armadilhas de Agentes de IA: Riscos e Como se Proteger

6 de abril de 2026

Com o avanço da inteligência artificial, especialmente os agentes de IA capazes de realizar tarefas complexas de forma autônoma, surgem novas preocupações com a segurança. Um recente relatório da DeepMind detalha como agentes de IA podem ser explorados por hackers, abrindo portas para ataques sofisticados e potencialmente devastadores. Entender essas vulnerabilidades e implementar medidas de proteção robustas é crucial para empresas que buscam adotar essa tecnologia de forma segura e responsável.

Ameaças Emergentes: Como Agentes de IA Podem Ser Hackeados

Os agentes de IA, apesar de suas capacidades impressionantes, não são imunes a ataques. O relatório da DeepMind identifica vários vetores de ataque, incluindo envenenamento de dados, manipulação de recompensas e exploração de vulnerabilidades em seus modelos de aprendizado. Um agente de IA malicioso pode ser programado para coletar informações confidenciais, realizar transações fraudulentas ou até mesmo causar danos físicos a sistemas conectados. A complexidade desses agentes e sua capacidade de aprender e se adaptar tornam a detecção e a mitigação de ameaças ainda mais desafiadoras.

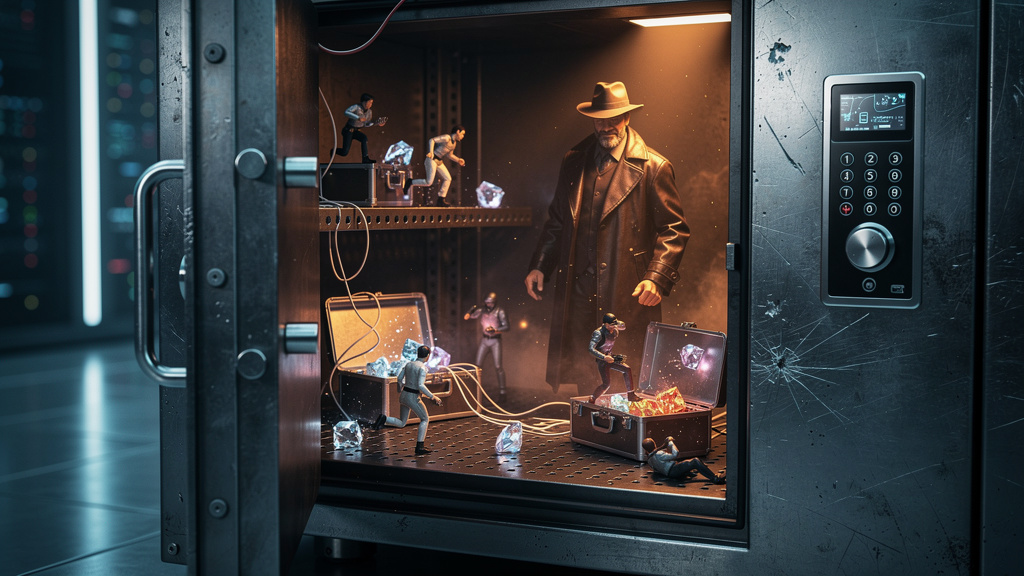

Vulnerabilidades em Aplicações Práticas

As vulnerabilidades em agentes de IA podem se manifestar em diversas aplicações. Por exemplo, um agente de IA usado para automatizar tarefas de atendimento ao cliente pode ser manipulado para divulgar informações confidenciais ou enganar os usuários. Em um cenário mais crítico, um agente de IA que controla sistemas de infraestrutura crítica, como redes elétricas ou sistemas de transporte, pode ser comprometido para causar interrupções em larga escala. A capacidade de um agente de IA de aprender com interações com o mundo real também pode ser explorada, permitindo que um invasor o treine para realizar ações maliciosas.

Agentes de IA e a Segurança no Atendimento ao Cliente

No contexto do atendimento ao cliente, o uso de agentes de IA, como os chatbots da Toolzz Chat, oferece inúmeras vantagens, como disponibilidade 24/7 e respostas rápidas. No entanto, a segurança é uma preocupação fundamental. Um agente de IA mal configurado ou vulnerável pode ser explorado para coletar informações pessoais de clientes, realizar tentativas de phishing ou até mesmo comprometer a reputação da empresa. É crucial implementar medidas de segurança robustas, como autenticação de dois fatores, criptografia de dados e monitoramento contínuo, para proteger os clientes e a empresa contra ataques.

Está preocupado com a segurança do seu atendimento? Conheça a Toolzz e descubra como proteger seus dados e seus clientes com soluções de IA seguras e confiáveis.

Estratégias de Mitigação: Protegendo sua Empresa

Para proteger sua empresa contra as ameaças representadas por agentes de IA maliciosos, é essencial adotar uma abordagem de segurança em camadas. Isso inclui:

- Validação de Dados: Implementar mecanismos robustos para validar os dados de entrada e garantir que o agente de IA não seja exposto a informações maliciosas.

- Monitoramento Contínuo: Monitorar o comportamento do agente de IA em tempo real para detectar anomalias e atividades suspeitas.

- Testes de Penetração: Realizar testes de penetração regulares para identificar vulnerabilidades em seus sistemas e agentes de IA.

- Atualizações de Segurança: Manter seus sistemas e agentes de IA atualizados com as últimas correções de segurança.

- Treinamento de Equipe: Capacitar sua equipe para reconhecer e responder a ameaças de segurança relacionadas à IA.

A implementação dessas estratégias pode parecer complexa, mas ferramentas como a Toolzz AI podem auxiliar na proteção e otimização dos seus agentes de IA, garantindo a segurança e a eficiência do seu negócio.

Além disso, é importante adotar uma abordagem de segurança proativa, antecipando as ameaças e implementando medidas preventivas. A segurança da IA é um processo contínuo que exige atenção constante e investimento em tecnologias e práticas de segurança.

Quer ver na prática?

Solicitar demonstraçãoDemo Bots

Explore a demo interativa do Toolzz Bots, uma poderosa plataforma no-code que permite a criação de chatbots que operam 24 horas por dia, 7 dias por semana.