Observabilidad de IA: Garantizando la Confiabilidad de tus Sistemas

Una guía completa sobre la importancia de la observabilidad en sistemas de inteligencia artificial, explorando cómo monitorear, entender y garantizar el rendimiento consistente de modelos de IA para proteger inversiones empresariales.

Observabilidad de IA: Garantizando la Confiabilidad de tus Sistemas

17 de marzo de 2026

La inteligencia artificial (IA) está transformando negocios, pero la confianza en sus resultados es fundamental. Con el aumento de incidentes y fallos de IA, la observabilidad surge como una solución crucial para monitorear, entender y garantizar el rendimiento consistente de sistemas inteligentes. Esta guía explora los pilares de la observabilidad de IA y cómo puede proteger tus inversiones.

El Problema de la Confianza en IA

Un informe de 2025 señala que el 95% de las empresas no ven retorno sobre sus inversiones en proyectos de IA. Los fallos e incidentes relacionados con la IA socavan la confianza de los consumidores e impiden la adopción generalizada. Imagina un modelo de predicción de fallos de equipos que, después de seis meses, pierde precisión, generando pérdidas e interrupciones. O, peor aún, un sistema de salud con diagnósticos imprecisos, poniendo vidas en riesgo. Estos escenarios, desafortunadamente, son reales y demuestran la importancia de monitorear continuamente la salud y el desempeño de la IA.

¿Qué es la Observabilidad de IA?

La observabilidad de IA es la capacidad de monitorear, entender y explicar el comportamiento de sistemas de IA. A diferencia de la observabilidad tradicional de software, que se concentra en métricas, logs y traces, la observabilidad de IA expande este alcance para incluir la calidad de los datos, la detección de desviaciones (drift) y la interpretabilidad de los modelos. En resumen, es como tener un panel de control completo de tu IA, permitiendo identificar y corregir problemas antes de que causen impactos negativos.

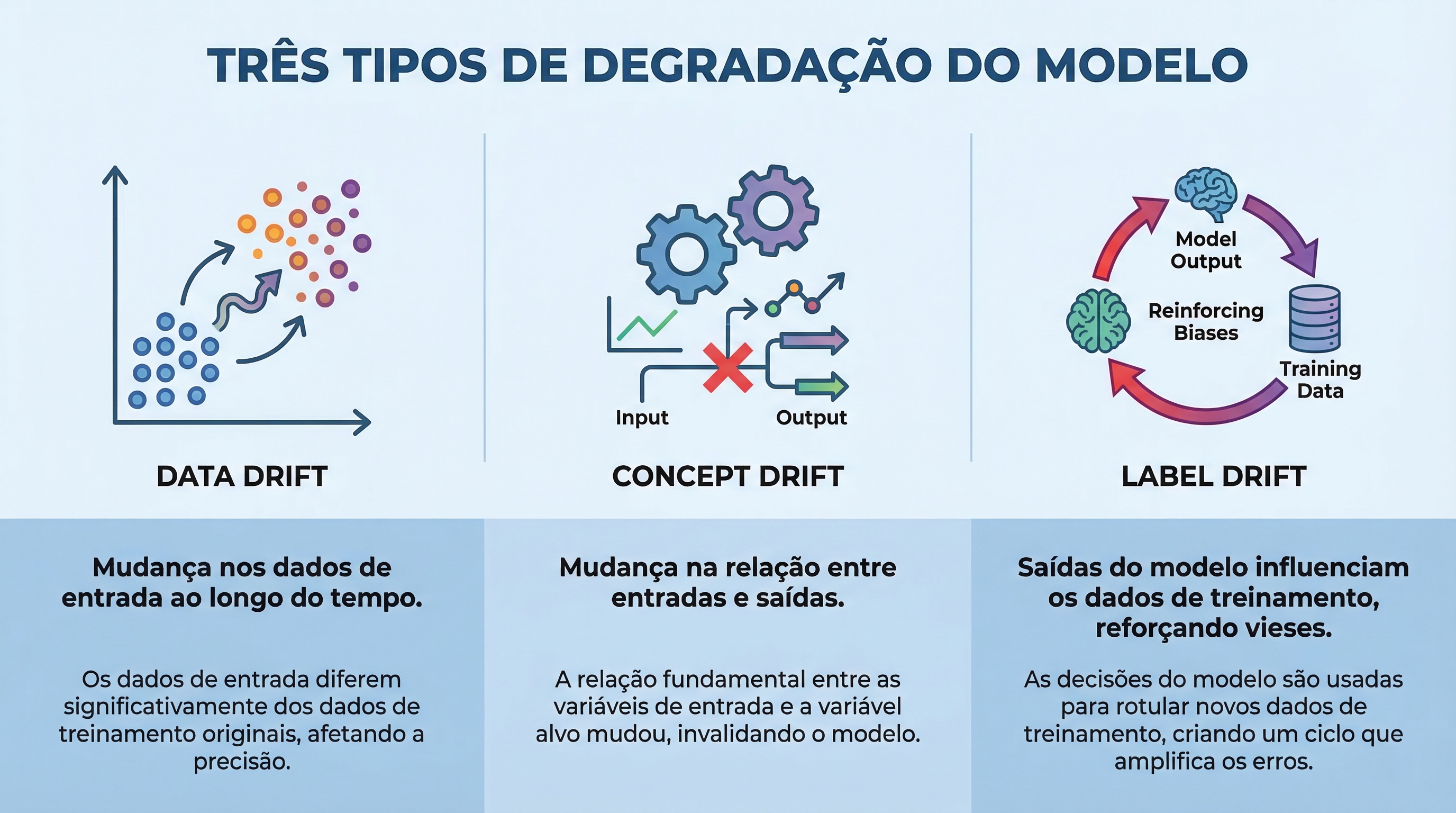

Las Tres Formas de Degradación de Modelos

Los modelos de IA no son estáticos; se degradan con el tiempo debido a diversos factores. Tres tipos principales de degradación son:

Data Drift: Ocurre cuando la distribución de los datos de entrada se desvía de los datos de entrenamiento originales. Un modelo de detección de fraudes entrenado con datos pre-pandemia puede volverse ineficaz con los cambios en los hábitos de consumo.

Concept Drift: La relación entre las entradas y las salidas del modelo cambia con el tiempo. Un modelo de score de crédito puede perder su precisión a medida que las condiciones económicas se alteran.

Label Drift: Cuando los resultados del modelo influencian los datos de entrenamiento subsecuentes, creando un ciclo de retroalimentación que refuerza sesgos e imprecisiones.

Estas formas de degradación no siempre generan errores tradicionales, como excepciones o lentitud, haciendo la observabilidad aún más crucial.

¿Quieres garantizar el rendimiento y confiabilidad de tus modelos de IA?

Solicitar demostración de Toolzz AI

El Caso Real del Epic Sepsis Model

El Epic Sepsis Model (ESM) es un ejemplo notorio de cómo la falta de observabilidad puede llevar a resultados desastrosos. Inicialmente con alta precisión, el modelo, integrado en un sistema de salud, presentó una caída significativa en su rendimiento cuando fue validado independientemente. La ausencia de monitoreo de desviaciones en los datos de entrada, como cambios en los códigos de medicamentos y en los patrones de laboratorio, contribuyó a esta degradación. La observabilidad habría alertado sobre estas señales, permitiendo una corrección proactiva.

Los Cinco Pilares de la Observabilidad de IA

Para implementar una observabilidad de IA eficaz, es necesario considerar cinco pilares fundamentales:

Monitoreo de la Calidad de los Datos: Verificar la integridad, la consistencia y la precisión de los datos de entrada.

Monitoreo del Rendimiento del Modelo: Acompañar métricas como precisión, recall y F1-score, utilizando métricas proxy cuando el feedback directo sea retrasado.

Explicabilidad e Interpretabilidad: Entender por qué el modelo tomó determinada decisión, utilizando técnicas como SHAP, LIME y atención.

Monitoreo de Fairness y Bias: Identificar y mitigar sesgos que puedan llevar a resultados discriminatorios.

Rastreo de Linaje y Proveniencia: Registrar todo el ciclo de vida del modelo, desde los datos de entrenamiento hasta la versión implementada.

¿Qué tal explorar herramientas que te ayuden a garantizar la calidad de los datos y el rendimiento de los modelos? Conoce Toolzz AI y descubre cómo podemos ayudarte.

Implementando la Observabilidad con Toolzz

Toolzz ofrece soluciones que simplifican la implementación de la observabilidad de IA. Con nuestros Agentes de IA, puedes monitorear continuamente el rendimiento de tus modelos, detectar desviaciones de datos y garantizar la fairness de los resultados. Además, nuestros chatbots no-code pueden ser integrados para alertar a los equipos sobre anomalías y proporcionar insights accionables. Toolzz Bots permite crear flujos de trabajo automatizados para investigar y corregir problemas de forma rápida y eficiente, minimizando el impacto en tus negocios.

Al invertir en observabilidad de IA, no solo garantizas la confiabilidad de tus sistemas de IA, sino que también maximizas el retorno sobre tus inversiones y construyes una base sólida para la innovación continua.

Mira lo fácil que es crear tu IA

Haz clic en la flecha abajo para comenzar una demostración interactiva de cómo crear tu propia IA.