Acceso Descontrolado a la IA: El Riesgo Invisible para Empresas

Con la rápida adopción de inteligencia artificial, las empresas enfrentan un nuevo desafío de seguridad: el acceso descontrolado de agentes de IA a datos sensibles, creando un escenario donde el riesgo se acumula silenciosamente sin ser detectado por las herramientas de seguridad tradicionales.

Acceso Descontrolado a la IA: El Riesgo Invisible para Empresas

17 de marzo de 2026

Con la rápida adopción de inteligencia artificial, las empresas enfrentan un nuevo desafío de seguridad: el acceso descontrolado de agentes de IA a datos sensibles. La proliferación de cuentas de servicio, combinada con la complejidad de los permisos en entornos de nube, crea un escenario donde el riesgo se acumula silenciosamente, muchas veces sin ser detectado por las herramientas de seguridad tradicionales.

La Evolución del Shadow IT: Del Dropbox a la IA

El concepto de Shadow IT no es nuevo. Inicialmente, se refería al uso de aplicaciones y servicios no autorizados por los empleados. Sin embargo, con el auge de la IA, el Shadow IT evolucionó hacia algo más insidioso: el acceso no gestionado y la acción autónoma de agentes de IA. No se trata solo de almacenamiento de datos no autorizado, sino de la capacidad de estos agentes de acceder, procesar y actuar con información confidencial sin supervisión adecuada.

Ejemplos Prácticos de Acceso Descontrolado

En muchas organizaciones, es común ver escenarios como: una integración de prueba de un asistente de codificación IA que permanece activa con acceso irrestricto al repositorio de código; un analista de negocios que automatiza tareas con credenciales personales, creando un flujo de trabajo que continúa ejecutándose incluso después de su salida del equipo; o frameworks de agentes que almacenan claves de API en registros de conversaciones. Estos casos, aparentemente inofensivos, pueden abrir brechas significativas en la seguridad de la empresa.

El problema es que estos accesos rara vez aparecen en los paneles de gestión de identidad y acceso (IAM). Las políticas de prevención de pérdida de datos (DLP) pueden no identificar las actividades de los agentes de IA como anormales. El resultado es un riesgo creciente, muchas veces invisible para los equipos de seguridad.

¿Está preocupado por la seguridad de su IA?

Solicite una demostración de Toolzz AIEl Problema de las Identidades No Humanas

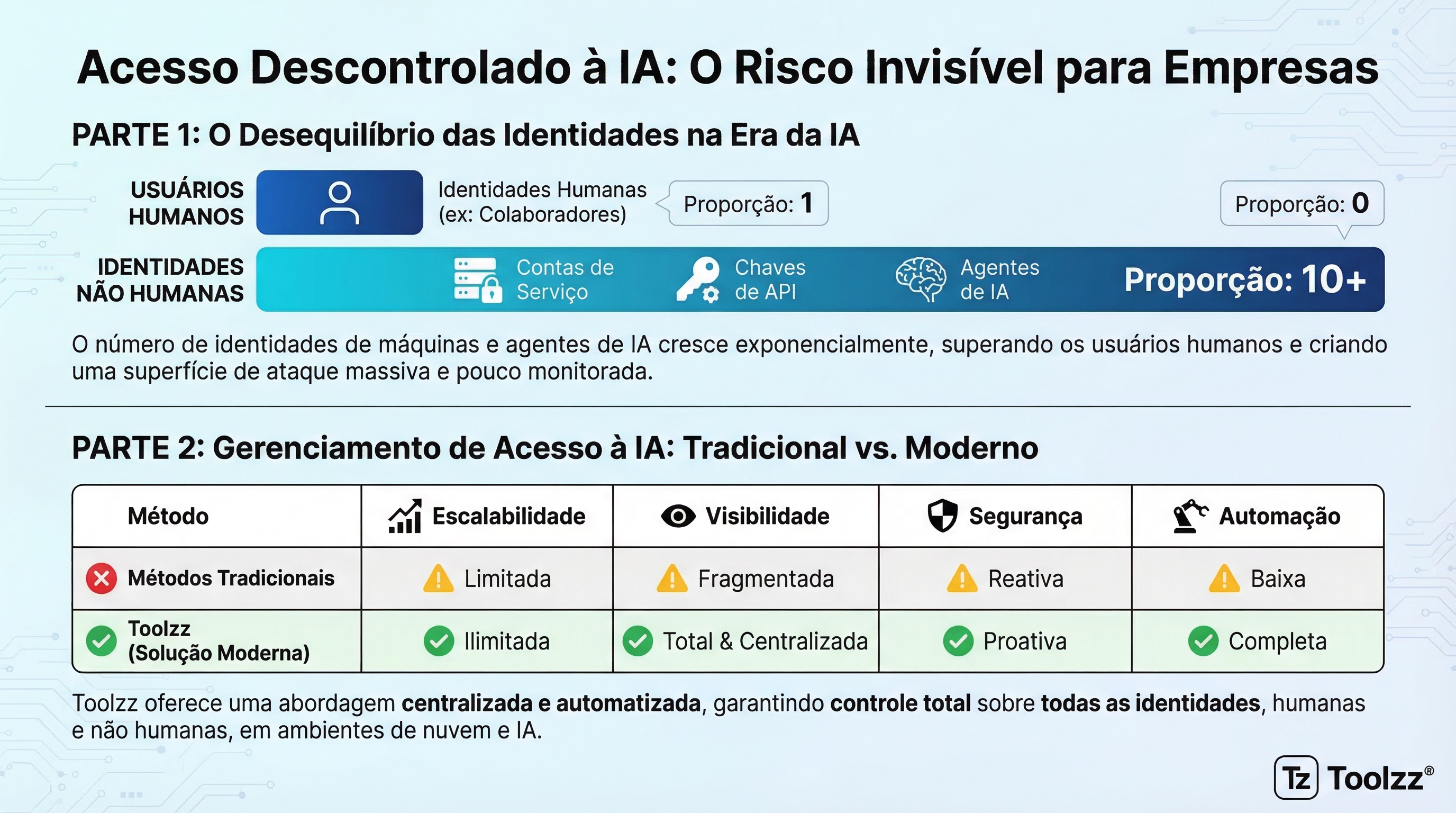

Las identidades no humanas – cuentas de servicio, identidades de carga de trabajo, claves de API y, cada vez más, agentes de IA – ya superan en número a los usuarios humanos en la mayoría de las empresas, en una proporción que puede llegar a 10:1. Gestionar estas identidades es un desafío complejo, especialmente porque requieren un modelo de gobernanza diferente del aplicado a usuarios humanos. A diferencia de los usuarios, las identidades no humanas no necesitan contraseñas o autenticación multifactor, pero aún así necesitan acceso controlado y monitoreo constante.

Acceso como Plano de Control para la Confianza en IA

La gobernanza de acceso es fundamental para garantizar la confianza en la IA. No basta con garantizar que los modelos de IA estén alineados con los valores de la empresa y que la salida sea filtrada. Es necesario controlar lo que los agentes de IA pueden realmente hacer, limitando su acceso a datos y sistemas. El enfoque debe evolucionar de "¿esta identidad está autorizada?" a "¿este patrón de acceso es consistente con lo que esta identidad debería estar haciendo ahora?". Para garantizar esta gobernanza y control, puede conocer las soluciones de Toolzz AI.

Prácticas para Implementación Responsable de Agentes de IA

Para mitigar los riesgos asociados al acceso descontrolado de agentes de IA, es esencial adoptar algunas prácticas recomendadas:

- Alcance de permisos en la implementación: Defina el acceso mínimo necesario para que cada agente de IA realice su tarea y bloquee la implementación hasta que estos permisos sean concedidos.

- Modelado conjunto de identidades: Gestione identidades humanas y no humanas de forma consistente, con las mismas políticas y procesos.

- Monitoreo continuo: Establezca líneas base de comportamiento para cada agente y detecte anomalías que puedan indicar acceso indebido o compromiso.

- Modelado de acceso antes de la implementación: Evalúe el impacto de nuevas integraciones y agentes de IA antes de ponerlos en producción.

Plataformas como Toolzz AI ofrecen recursos avanzados para gestión de identidades y control de acceso, permitiendo que las empresas monitoreen y restrinjan el acceso de sus agentes de IA en tiempo real. Además, Toolzz LXP puede auxiliar en la concientización y capacitación de los empleados sobre las mejores prácticas de seguridad para IA.

¿Quiere capacitar a su equipo para enfrentar los desafíos de la IA? Explore los recursos de Toolzz LXP y promueva una cultura de seguridad y aprendizaje continuo.

Conclusión

El acceso descontrolado de agentes de IA representa un riesgo creciente para la seguridad empresarial. Al adoptar un enfoque proactivo e implementar las prácticas recomendadas, las empresas pueden reducir significativamente su exposición y garantizar que la IA sea utilizada de forma responsable y segura. Ignorar este problema puede llevar a violaciones de datos, pérdidas financieras y daños a la reputación. La seguridad de la IA no es solo una cuestión técnica, sino también una responsabilidad de gestión.

Vea qué fácil es crear su IA

Haga clic en la flecha abajo para comenzar una demostración interactiva de cómo crear su propia IA.