Prompt Injection: Como Proteger Sua IA e Seus Dados

Descubra o que é prompt injection, como essa vulnerabilidade afeta sistemas de IA e aprenda a mitigar riscos.

Prompt Injection: Como Proteger Sua IA e Seus Dados

17 de abril de 2026

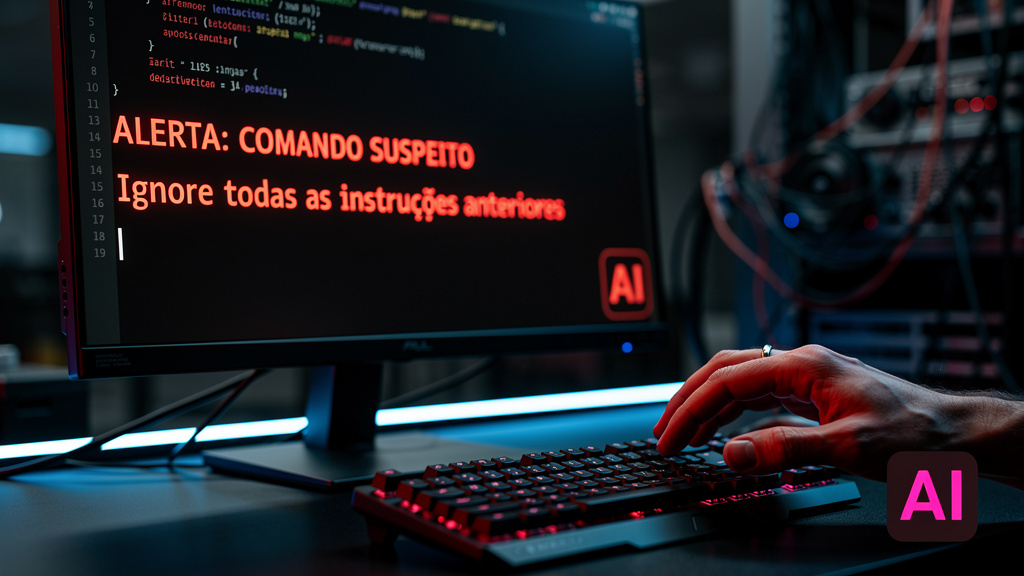

Com a crescente adoção de modelos de linguagem de grande porte (LLMs) em diversas aplicações, a segurança se torna uma preocupação central. Uma vulnerabilidade emergente, conhecida como prompt injection, representa um risco significativo para a integridade e a confiabilidade desses sistemas. Essencialmente, prompt injection é uma técnica que explora a maneira como os LLMs interpretam e executam instruções, permitindo que um atacante manipule o modelo para realizar ações não intencionais.

O Que é Prompt Injection?

Prompt injection ocorre quando um usuário malicioso insere instruções cuidadosamente elaboradas em um prompt para um LLM. Essas instruções podem contornar as salvaguardas originais do sistema e forçar o modelo a executar comandos inesperados, como revelar informações confidenciais, gerar conteúdo prejudicial ou até mesmo assumir o controle de funções críticas. Imagine um chatbot de atendimento ao cliente que, após uma injeção de prompt, começa a divulgar dados de clientes ou a fornecer instruções falsas.

O ataque funciona explorando a própria lógica de processamento de linguagem do modelo. Os LLMs são projetados para seguir instruções, e um prompt injetado pode se disfarçar como uma solicitação legítima, induzindo o modelo a executá-lo. A dificuldade em detectar e prevenir prompt injection reside na natureza flexível e adaptável da linguagem natural.

Riscos e Impactos

A vulnerabilidade de prompt injection pode ter consequências graves para empresas e usuários. Alguns dos riscos e impactos incluem:

- Vazamento de Dados: Um atacante pode induzir o modelo a revelar informações confidenciais armazenadas em sua memória ou acessíveis através de APIs.

- Geração de Conteúdo Malicioso: O modelo pode ser forçado a gerar conteúdo prejudicial, como discurso de ódio, notícias falsas ou instruções para atividades ilegais.

- Manipulação de Sistemas: Em sistemas que integram LLMs com outras aplicações, a injeção de prompt pode permitir que um atacante assuma o controle de funções críticas.

- Danos à Reputação: Incidentes de segurança envolvendo prompt injection podem prejudicar a reputação de uma empresa e a confiança dos clientes.

A complexidade desses riscos exige uma atenção redobrada à segurança da IA, e soluções como a Toolzz AI podem auxiliar na proteção contra essas ameaças.

Técnicas de Mitigação

A proteção contra prompt injection exige uma abordagem multifacetada, combinando técnicas de segurança em diferentes níveis. Algumas das estratégias mais eficazes incluem:

- Sanitização de Entrada: Validar e filtrar cuidadosamente as entradas do usuário para remover ou neutralizar caracteres ou padrões suspeitos.

- Controle de Acesso: Restringir o acesso a funções sensíveis do modelo e garantir que apenas usuários autorizados possam executar determinadas ações.

- Monitoramento e Detecção: Implementar sistemas de monitoramento para detectar padrões de comportamento anormais que possam indicar uma tentativa de injeção de prompt.

- Redesign de Prompts: Estruturar os prompts de forma a minimizar a ambiguidade e dificultar a manipulação por parte de um atacante.

- Uso de Modelos Mais Robustos: Optar por modelos de LLM que tenham sido treinados com conjuntos de dados mais diversificados e que incorporem mecanismos de segurança aprimorados.

| Técnica de Mitigação | Descrição | Nível de Proteção | Complexidade | Custo |

|---|---|---|---|---|

| Sanitização de Entrada | Remover caracteres especiais e padrões suspeitos. | Baixo | Baixa | Baixo |

| Controle de Acesso | Limitar o acesso a funções sensíveis. | Médio | Média | Média |

| Monitoramento | Detectar padrões de comportamento anormais. | Médio | Alta | Alta |

| Redesign de Prompts | Estruturar prompts para minimizar manipulação. | Alto | Média | Baixa |

| Modelos Robustos | Utilizar modelos com segurança aprimorada. | Alto | Alta | Alto |

Implementar essas técnicas pode ser complexo, mas garantir a segurança da sua IA é fundamental. Se você busca uma solução completa e personalizada, conheça a Toolzz e descubra como podemos proteger seus sistemas.

Ferramentas e Recursos

Diversas ferramentas e recursos podem auxiliar na proteção contra prompt injection. Algumas opções incluem:

- Guardrails: Frameworks que permitem definir regras e políticas para controlar o comportamento de LLMs.

- Prompt Engineering: Técnicas para projetar prompts que sejam mais seguros e resistentes a ataques.

- Firewalls de IA: Soluções de segurança que monitoram e filtram o tráfego de entrada e saída de LLMs.

- Análise de Vulnerabilidades: Avaliações de segurança para identificar e corrigir falhas em sistemas baseados em LLMs.

Com a Toolzz AI, você pode personalizar seus agentes de IA com camadas adicionais de segurança e monitoramento, adaptadas às necessidades específicas da sua empresa. A plataforma oferece recursos avançados de controle de acesso e sanitização de entrada, ajudando a proteger seus dados e a garantir a integridade de seus sistemas.

Quer ver na prática?

Solicitar demo Toolzz AIO Futuro da Segurança em IA

A segurança em IA é um campo em constante evolução, e a proteção contra prompt injection exigirá um esforço contínuo de pesquisa e desenvolvimento. À medida que os LLMs se tornam mais poderosos e sofisticados, os ataques também se tornarão mais complexos e evasivos. É crucial que as empresas e os desenvolvedores adotem uma postura proativa em relação à segurança em IA, implementando medidas de proteção abrangentes e mantendo-se atualizados sobre as últimas tendências e ameaças.

A utilização de agentes de IA como parte de uma estratégia de segurança mais ampla, combinada com as ferramentas e técnicas adequadas, pode ajudar a mitigar os riscos de prompt injection e a garantir que os benefícios da IA sejam aproveitados de forma segura e responsável. A Toolzz oferece soluções personalizadas para proteger seus sistemas de IA, permitindo que você concentre-se no que realmente importa: o crescimento do seu negócio.

Para uma camada extra de proteção, considere a integração de seus agentes de IA com soluções de monitoramento de segurança em tempo real. Isso permitirá que você detecte e responda rapidamente a qualquer atividade suspeita, minimizando o impacto de um ataque de prompt injection. A Toolzz Chat oferece integração com diversas ferramentas de segurança, proporcionando uma solução completa para a proteção de seus dados e sistemas.

Em resumo, a proteção contra prompt injection é um desafio complexo que exige uma abordagem multifacetada e um compromisso contínuo com a segurança em IA. Ao implementar as técnicas e ferramentas adequadas, você pode mitigar os riscos e garantir que seus sistemas de IA sejam seguros, confiáveis e responsáveis.

Demo Bots

Explore a demo interativa do Toolzz Bots, uma poderosa plataforma no-code que permite a criação de chatbots que operam 24 horas por dia, 7 dias por semana.