Framework completo para escalar Prompt Engineering

Domine prompt engineering, context window e inferência LLM para otimizar seus agentes de IA.

Framework completo para escalar Prompt Engineering

7 de abril de 2026

Com a crescente adoção de modelos de linguagem de grande porte (LLMs) como o GPT-4, a capacidade de criar instruções eficazes – o chamado prompt engineering – se tornou uma habilidade crucial para empresas que buscam automatizar tarefas, melhorar o atendimento ao cliente e impulsionar a inovação. Este guia completo explora as nuances do prompt engineering, a importância do context window e os fundamentos da inferência LLM, oferecendo um framework para escalar o uso de IA em sua organização.

O que é Prompt Engineering e por que é importante?

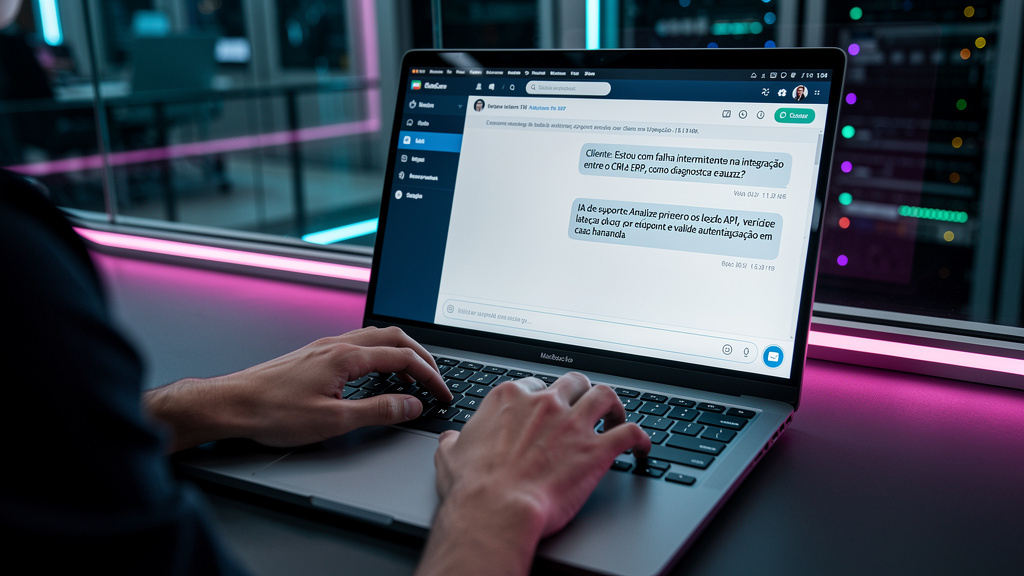

Prompt engineering é a arte e a ciência de criar prompts (instruções) que direcionam LLMs a gerar as respostas desejadas. Um prompt bem elaborado pode transformar um LLM genérico em uma ferramenta altamente especializada para sua empresa. A importância reside na capacidade de extrair o máximo valor dos modelos de IA sem a necessidade de retreinamento, economizando tempo e recursos. Exemplos de aplicações incluem a criação de chatbots inteligentes com a Toolzz Bots, a geração de conteúdo personalizado e a automação de tarefas complexas de análise de dados.

Quer otimizar seus prompts e ver resultados reais? Agende uma demonstração com a Toolzz e descubra como podemos impulsionar sua estratégia de IA.

Entendendo o Context Window: A Memória do Modelo

O context window (janela de contexto) define a quantidade de texto que um LLM pode processar em uma única interação. Pense nisso como a memória do modelo. Um context window maior permite que o modelo considere mais informações ao gerar uma resposta, resultando em maior precisão e relevância. No entanto, context windows maiores também exigem mais poder computacional e podem aumentar os custos. A escolha do tamanho ideal do context window depende da complexidade da tarefa e das capacidades do modelo. Plataformas como a Toolzz AI permitem otimizar o uso do context window para diferentes aplicações e modelos.

Inferência LLM: Do Modelo à Aplicação

A inferência LLM é o processo de usar um LLM treinado para gerar previsões ou respostas a partir de novos dados. É a fase em que o modelo é colocado em prática. A inferência pode ser realizada localmente, na nuvem ou em dispositivos de borda. A otimização da inferência é fundamental para garantir tempos de resposta rápidos e custos eficientes. A Toolzz AI oferece soluções de inferência escaláveis e otimizadas para diferentes necessidades de negócios.

Técnicas Avançadas de Prompt Engineering

Existem diversas técnicas para aprimorar a eficácia dos prompts. Algumas das mais populares incluem:

- Zero-shot prompting: Pedir ao modelo para realizar uma tarefa sem fornecer nenhum exemplo.

- Few-shot prompting: Fornecer alguns exemplos para guiar o modelo.

- Chain-of-thought prompting: Incentivar o modelo a explicar seu raciocínio passo a passo.

- Role prompting: Atribuir um papel específico ao modelo (ex: “Você é um especialista em marketing…”).

Experimentar com diferentes técnicas e combinações pode levar a resultados significativamente melhores. Ferramentas de teste e avaliação de prompts, integradas em plataformas como a Toolzz AI, ajudam a identificar os prompts mais eficazes.

Implementando Prompt Engineering em sua Empresa

A implementação bem-sucedida do prompt engineering requer uma abordagem estratégica e colaborativa. Aqui estão algumas dicas:

- Defina seus objetivos: Determine quais tarefas você deseja automatizar ou aprimorar com IA.

- Escolha o modelo certo: Selecione um LLM que seja adequado para suas necessidades específicas.

- Crie um repositório de prompts: Mantenha um registro organizado de seus prompts e seus resultados.

- Teste e itere: Avalie continuamente o desempenho de seus prompts e faça ajustes conforme necessário.

- Capacite sua equipe: Ofereça treinamento e recursos para que sua equipe possa dominar as técnicas de prompt engineering. A Toolzz LXP pode ser usada para criar trilhas de aprendizado personalizadas sobre IA e prompt engineering.

Quer ver na prática?

Agendar DemoFerramentas e Plataformas para Prompt Engineering

Além da Toolzz AI, diversas outras ferramentas e plataformas podem auxiliar no processo de prompt engineering. Algumas opções populares incluem:

| Ferramenta | Descrição | Preço |

|---|---|---|

| OpenAI Playground | Interface web para experimentar com modelos OpenAI | Gratuito e pago |

| PromptBase | Marketplace de prompts pré-criados | Pago |

| Dust | Plataforma para colaboração em prompt engineering | Pago |

| Toolzz AI | Plataforma de Agentes de IA personalizados para escalar automação | Gratuito e Pago (https://toolzz.com.br/ai#pricing) |

Ao escolher uma ferramenta, considere suas necessidades específicas, seu orçamento e o nível de suporte técnico oferecido.

Conclusão

O prompt engineering é uma habilidade essencial para empresas que desejam aproveitar ao máximo o potencial da IA. Ao entender os princípios básicos do prompt engineering, do context window e da inferência LLM, e ao adotar uma abordagem estratégica e colaborativa, você pode escalar o uso de IA em sua organização e obter resultados significativos. A Toolzz AI oferece as ferramentas e o suporte necessários para transformar sua visão de IA em realidade.

Demonstração LXP

Experimente uma demonstração interativa da nossa plataforma LXP e descubra como podemos transformar o aprendizado na sua organização.