Como AI Evals eliminam o trabalho manual

Descubra como automatizar a avaliação de IA com manifestos de contexto e garantir a qualidade do seu modelo.

Como AI Evals eliminam o trabalho manual

16 de abril de 2026

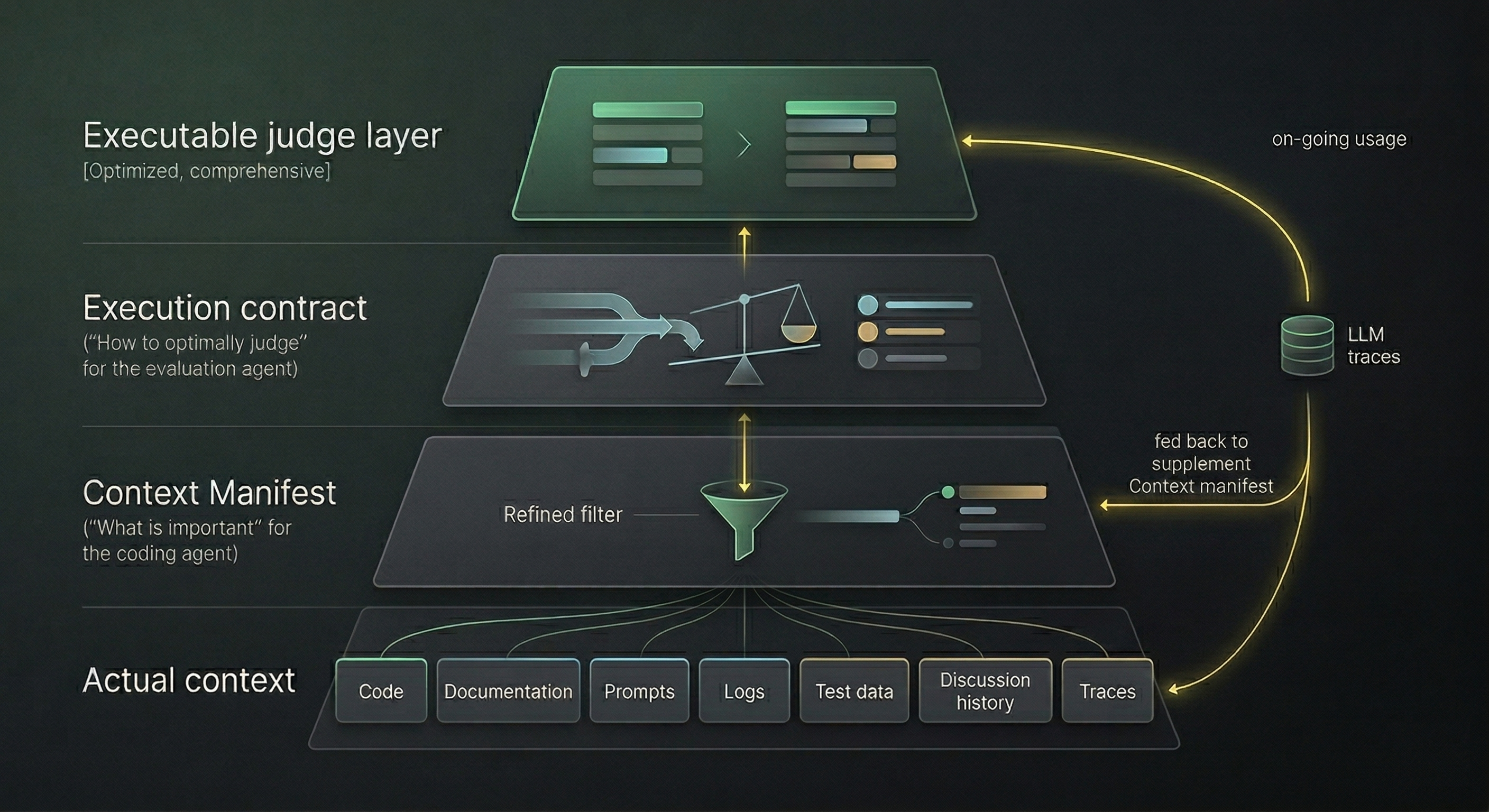

Com a crescente adoção de inteligência artificial em diversas aplicações, a avaliação da qualidade e confiabilidade dos modelos de IA tornou-se um desafio crucial. Métodos tradicionais, como avaliação manual e testes extensivos, são demorados, caros e difíceis de escalar. A abordagem de "pedir para Claude" ou depender excessivamente de dados de produção, embora populares, apresentam limitações significativas. Este artigo explora uma nova abordagem para a avaliação de IA, baseada na criação de "Context Manifests" e "Execution Contracts", que automatiza o processo de avaliação de forma confiável e eficiente.

O Problema com Avaliações Tradicionais

A construção de uma avaliação robusta para recursos de IA frequentemente começa com a observação de problemas em rastreamentos, um método robusto, mas lento, limitado, caro e difícil de iniciar. Exigir 50 falhas rotuladas antes de definir algo útil bloqueia o trabalho inicial de avaliação, dependendo de tempo, especialistas e esforço manual. Uma alternativa comum é pedir a um agente de IA, como Claude, para construir todo o conjunto de testes para as chamadas LLM em sua base de código. No entanto, essa abordagem também apresenta desvantagens significativas. É cognitivamente exigente para um agente de codificação construir perfeitamente tanto o sistema quanto a camada de confiança para esse sistema, resultando frequentemente em uma camada de confiança superficial e descuidada. Além disso, verificar a qualidade e cobertura do conjunto de testes criado pelo agente requer um esforço humano considerável, e a criação do stack de hospedagem e orquestração introduz mais complexidades e custos.

Está cansado de avaliações manuais e demoradas? Conheça a Toolzz AI e automatize a avaliação de seus modelos de IA com precisão e eficiência.

A Solução: O Padrão do Promotor

A solução proposta é alavancar o agente de codificação local para otimizar o código operacional, enquanto um agente especializado lida com os desafios específicos de avaliação. A abordagem orientada por dados é valiosa, mas ignora o contexto que os desenvolvedores já conhecem sobre a aplicação. Esse contexto reside em prompts, políticas, testes existentes, estrutura do código, documentação interna e a compreensão do desenvolvedor sobre o que cada chamada LLM deve fazer. Ignorar esse contexto seria um erro.

O padrão do promotor envolve o agente de codificação em montar um Context Manifest: um pacote estruturado e mínimo de tudo que é relevante para definir a semântica de cada chamada não determinística (LLM) em sua aplicação. Esse manifesto inclui prompts, referências de código, políticas, exemplos, restrições e documentação. Um avaliador meta distinto transforma esse manifesto em um Execution Contract, que define o que um comportamento bem-sucedido se parece e como deve ser julgado, compilando-o em avaliadores executáveis. O agente de codificação, então, integra esses avaliadores nos locais apropriados no código. Este protocolo codifica um padrão geral ("promotor - auditor - juízes") que é independente da implementação.

Context Layers e o Gargalo de Informação

O processo envolve a compressão de todo o conteúdo contextual em um Context Manifest (JSON/YAML) que detalha o que cada chamada específica deve fazer, sob quais restrições. Um exemplo de manifesto pode incluir:

yaml task_identity: name: "Sumarização de Artigos" agent: "Claude Code"

intent: primary_goal_of_task: "Resumir artigos longos em um parágrafo conciso e informativo." required_capabilities_for_task: - "Compreensão de linguagem natural" - "Geração de texto conciso"

success_criteria_of_task: essential: - "O resumo deve capturar os pontos principais do artigo." - "O resumo deve ser gramaticalmente correto e coerente."

failure_modes_of_task: critical: - "O resumo deve conter informações factualmente incorretas." - "O resumo deve ser plagiado de outras fontes."

representative_examples: labeled: - id: "ex_001" input: "Artigo sobre mudanças climáticas." output: "Resumo sobre o impacto das mudanças climáticas na agricultura." label: "positive" justification: "O resumo captura os pontos principais do artigo."

issues: confirmed_gaps: - "Falta de exemplos de artigos sobre tópicos técnicos complexos."

Este processo cria um gargalo de informação que facilita o foco do agente avaliador meta nas coisas certas e reduz a probabilidade de overfitting.

Lidar com Lacunas no Contexto

Embora a base de código forneça insights sobre o propósito, raramente contém dados de teste abrangentes ou informações de suporte consistentes. Por exemplo, pode ser inferido a necessidade de uma avaliação de "aderência à política", mas a política real pode estar faltando. Nesses casos, avaliadores semelhantes a "slop" podem ser criados, que são "do tipo certo", mas não podem realmente operar. Reconhecer essas lacunas é fundamental, e a lista de lacunas pode ser tratada como um recurso valioso. Essas lacunas podem ser enviadas de volta ao agente de codificação ou aos desenvolvedores para solução.

Benefícios da Abordagem

Esta abordagem oferece várias vantagens:

- Otimização do esforço do usuário: Não há necessidade de criar manualmente cada métrica, rubrica ou definição de juiz do zero.

- Maior privacidade: A unidade de transferência é o manifesto, não toda a aplicação.

- Separação clara de responsabilidades: O agente de codificação é responsável pela lógica do produto, enquanto o agente avaliador meta é responsável pela construção, orquestração e refinamento do juiz.

- Visibilidade de semântica ausente: Forçar informações ausentes a serem explicitadas melhora as avaliações e os prompts subjacentes.

- Aproveitamento de poder de juiz externo: A construção do manifesto pode ser realizada por um agente local com um modelo menos potente, enquanto o agente avaliador meta pode usar os modelos grandes mais recentes.

Quer ver na prática?

Solicite uma demonstraçãoA Analogia do Tribunal

Imagine avaliar a IA como julgar um réu em um tribunal. O promotor prepara o caso, apresentando as evidências e os argumentos que sustentam as acusações. O juiz, com base em seu conhecimento e experiência, toma uma decisão sobre a culpa ou inocência do réu. A avaliação da IA segue um processo semelhante, onde o agente de codificação atua como o promotor, preparando o "Context Manifest", o agente avaliador meta atua como o juiz, e a pilha de avaliação atua como o júri, avaliando todos os aspectos do caso.

Limitações Conhecidas

- A capacidade do agente de encontrar todos os dados de teste relevantes localmente e reconhecer lacunas ainda precisa ser testada em casos complexos.

- Se os dados de uso significativos estiverem disponíveis apenas por meio de uma plataforma de observabilidade de terceiros, a integração pode ser menos robusta.

- A abordagem depende de um Context Manifest inicial correto; se a avaliação inicial for fundamentalmente incorreta, os agentes podem não conseguir se recuperar.

Perguntas Frequentes

Por que usar essa abordagem em vez de simplesmente pedir a Claude para criar todo o conjunto de testes? Embora possível, essa abordagem pode levar a desafios de manutenção, pois você se torna responsável por manter o código da aplicação, os casos de teste, as definições de pilha de avaliação e a calibração do juiz.

Como isso se compara a outras abordagens? Este padrão se assemelha a scripts de integração do Sentry e do Posthog, bem como ao trabalho de Hamel Husain em "evaluation skills", mas é mais abrangente.

Não seria mais fácil compartilhar toda a base de código com o agente? Embora possa ser mais simples, isso levanta preocupações com a privacidade e pode não ser adequado para projetos complexos.

E quanto aos dados reais? Se os dados reais estiverem disponíveis, eles devem informar o manifesto! A Toolzz AI, por exemplo, permite a integração fácil de dados de produção para refinar métricas e juízes.

Com a Toolzz AI e suas capacidades de agentes personalizados, as empresas podem automatizar a criação e manutenção de avaliações de IA robustas, garantindo a qualidade e confiabilidade de seus modelos. A Toolzz LXP pode ser usada para educar as equipes sobre a importância das avaliações de IA e como usar as ferramentas e técnicas certas. Para empresas que buscam soluções completas de IA, a Toolzz oferece uma variedade de produtos e serviços para atender às suas necessidades.

Com a abordagem certa, a avaliação de IA pode se tornar mais eficiente, confiável e escalável. Ao adotar o padrão do promotor e alavancar ferramentas como a Toolzz AI, as empresas podem liberar o poder da IA com confiança.

Veja como é fácil criar sua IA

Clique na seta abaixo para começar uma demonstração interativa de como criar sua própria IA.