Ollama: Execute Modelos de Linguagem Grandes Localmente

Descubra como usar Ollama para rodar LLMs localmente,

Ollama: Execute Modelos de Linguagem Grandes Localmente

15 de março de 2026

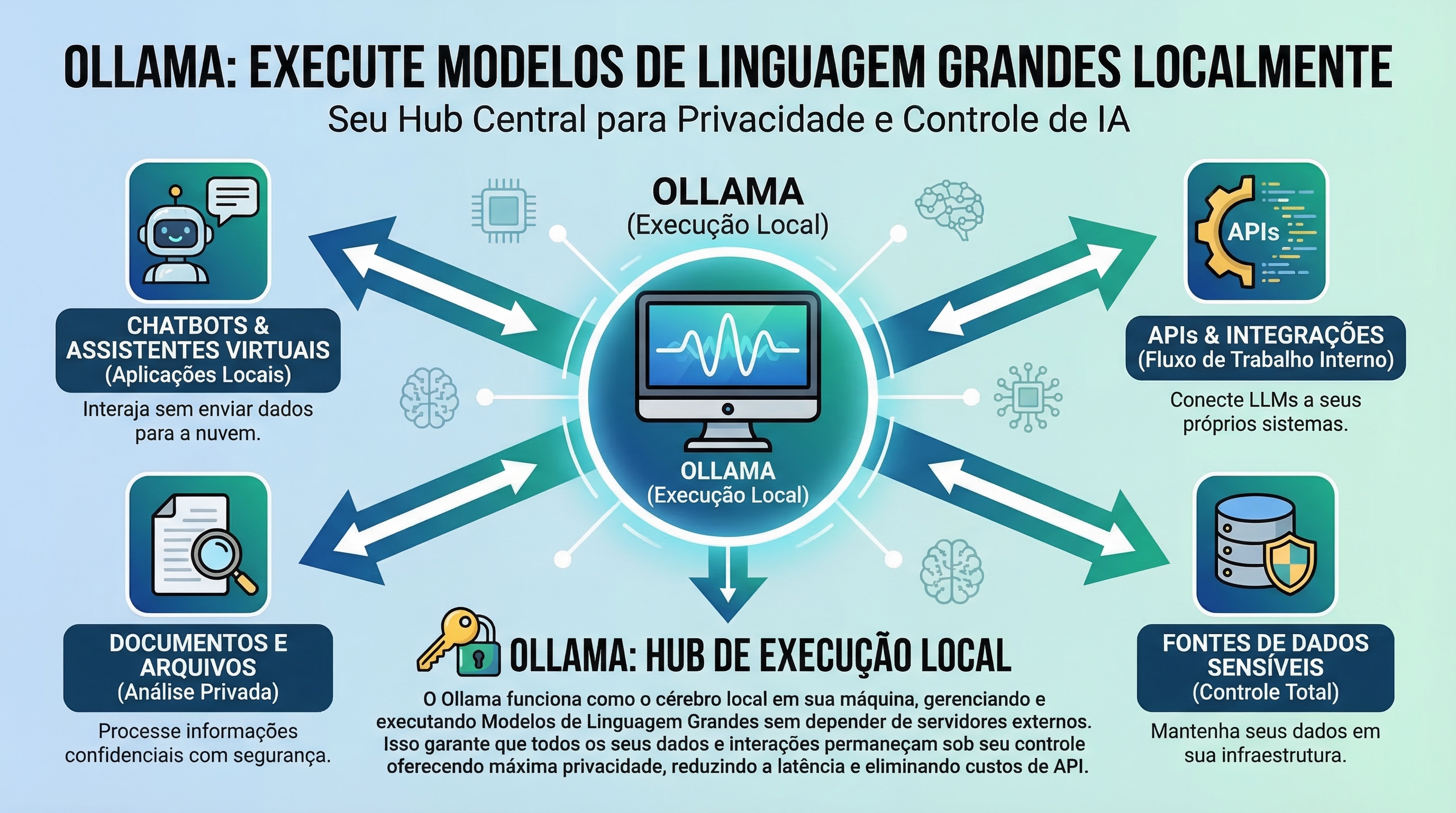

A crescente popularidade de modelos de linguagem grandes (LLMs) como o GPT-3 tem aberto novas possibilidades para automação e inteligência artificial. No entanto, o acesso a esses modelos frequentemente depende de APIs pagas e da necessidade de enviar dados para servidores externos, levantando preocupações sobre privacidade e custos. O Ollama surge como uma solução promissora, permitindo que você execute LLMs diretamente em sua máquina local, oferecendo controle total e eliminando a dependência de serviços de terceiros.

O Que é Ollama e Por Que Usá-lo?

Ollama é uma ferramenta de código aberto que simplifica o processo de download, configuração e execução de LLMs em seu computador. Ele abstrai a complexidade da gestão de dependências e configurações, fornecendo uma interface de linha de comando intuitiva para interagir com os modelos. Ao executar LLMs localmente, você garante que seus dados permaneçam privados, evita custos de API e obtém maior flexibilidade para personalizar e adaptar os modelos às suas necessidades. Isso abre portas para diversas aplicações, desde desenvolvimento de chatbots e assistentes virtuais até tarefas de geração de texto e análise de dados.

Instalando e Configurando o Ollama

A instalação do Ollama é um processo simples e direto. Ele está disponível para macOS, Linux e Windows (via WSL2). O site oficial (https://ollama.com/) fornece instruções detalhadas para cada sistema operacional. Após a instalação, você pode começar a usar o Ollama imediatamente, sem a necessidade de configurar variáveis de ambiente ou instalar dependências adicionais. A ferramenta se encarrega de lidar com todos os detalhes técnicos, permitindo que você se concentre no uso dos modelos.

Baixando e Gerenciando Modelos

Ollama oferece um catálogo crescente de modelos pré-treinados, que podem ser baixados e executados com um único comando. Para listar os modelos disponíveis, use o comando ollama pull. Você também pode pesquisar modelos específicos usando o comando ollama pull <nome_do_modelo>. Após o download, o modelo estará disponível para uso imediato. O Ollama gerencia automaticamente o armazenamento e a versão dos modelos, facilitando a atualização e a alternância entre diferentes opções. É importante notar que o tamanho dos modelos pode variar significativamente, então certifique-se de ter espaço de armazenamento suficiente em seu disco.

Se você está buscando explorar o poder da IA para otimizar suas operações, considere as soluções que a Toolzz AI tem a oferecer.

Interagindo com LLMs no Terminal

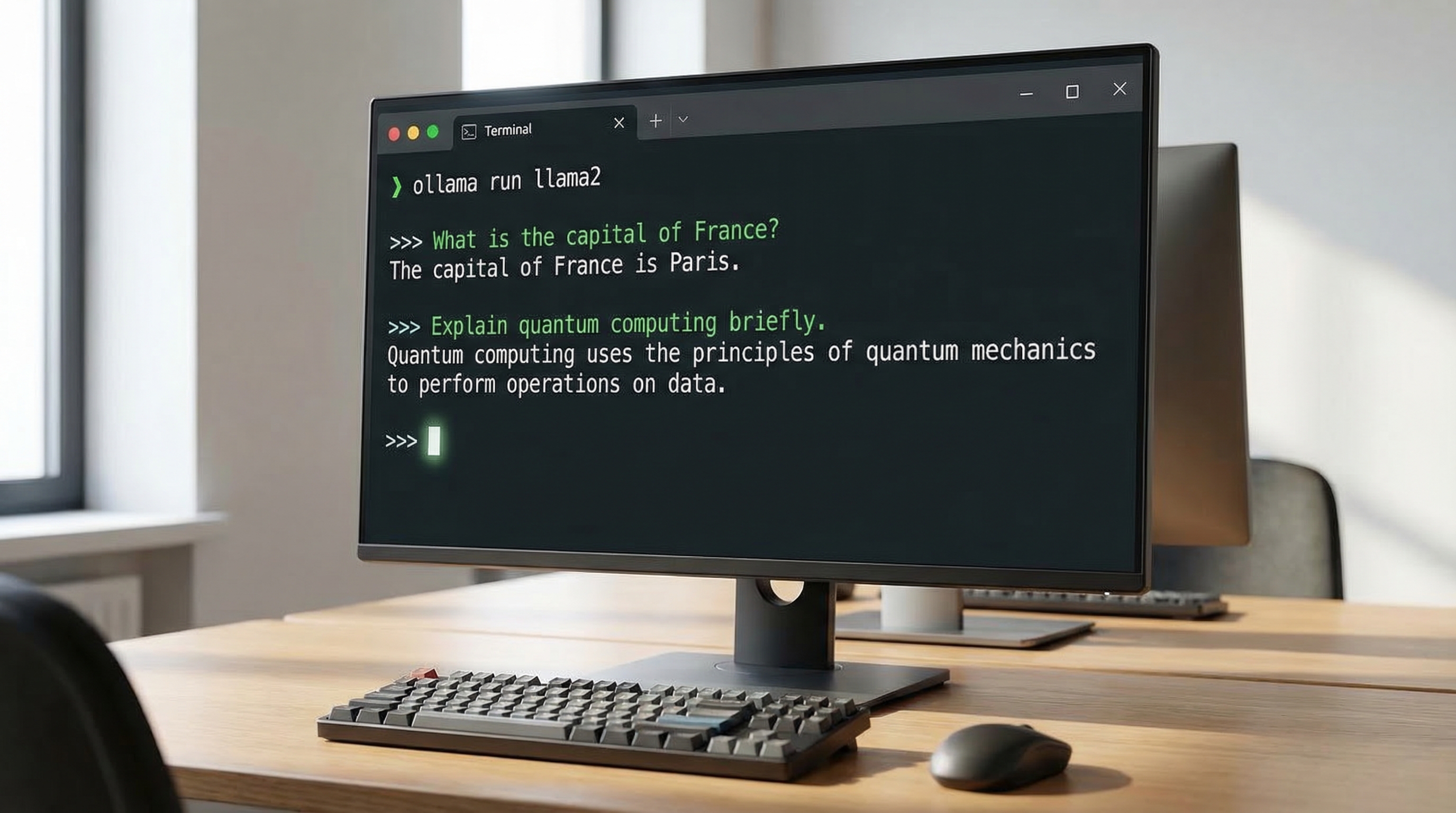

Uma vez que o modelo esteja baixado, você pode começar a interagir com ele diretamente no terminal. O comando ollama run <nome_do_modelo> inicia uma sessão interativa, onde você pode inserir prompts e receber respostas do modelo. O Ollama se encarrega de lidar com a comunicação e o processamento, apresentando as respostas de forma clara e organizada. Você pode usar essa interface para testar diferentes prompts, explorar as capacidades do modelo e ajustar os parâmetros para obter os resultados desejados. A simplicidade da interface de linha de comando torna o Ollama acessível mesmo para usuários sem experiência em programação.

Integrando Ollama com Ferramentas de Desenvolvimento

Ollama pode ser facilmente integrado com ferramentas de desenvolvimento, como editores de código e IDEs. Isso permite que você aproveite os LLMs em seus projetos de software, automatizando tarefas como geração de código, documentação e testes. A ferramenta oferece APIs e bibliotecas que facilitam a comunicação com os modelos, permitindo que você crie aplicativos personalizados e fluxos de trabalho automatizados. Além disso, o Ollama pode ser usado em conjunto com outras ferramentas de IA, como frameworks de aprendizado de máquina e bibliotecas de processamento de linguagem natural, expandindo ainda mais suas capacidades.

Automatize suas tarefas com IA! Solicite uma demonstração da Toolzz AI e veja como podemos transformar seus processos.

Ollama e o Futuro da IA Local

O Ollama representa um passo importante em direção a um futuro onde a inteligência artificial é mais acessível, privada e personalizável. Ao permitir que os usuários executem LLMs localmente, ele democratiza o acesso a essa tecnologia poderosa e capacita os desenvolvedores a criar aplicativos inovadores sem depender de serviços de terceiros. Combinado com a capacidade de personalização oferecida por plataformas como a Toolzz AI, que permite a criação de agentes de IA customizados, o Ollama abre novas possibilidades para automação e inteligência artificial em empresas de todos os portes. Ao reduzir a dependência de APIs externas, o Ollama também contribui para a criação de soluções mais resilientes e seguras.

Em resumo, o Ollama é uma ferramenta poderosa e versátil que simplifica o processo de execução de LLMs localmente, garantindo privacidade, eliminando custos e abrindo novas possibilidades para automação e inteligência artificial. Se você busca uma forma de experimentar e integrar LLMs em seus projetos, o Ollama é uma excelente opção.