LLMs como Programas de Linha de Comando: A Nova Fronteira da Automação

Explore como LLMs podem ser usados como ferramentas de

LLMs como Programas de Linha de Comando: A Nova Fronteira da Automação

20 de março de 2026

A inteligência artificial generativa, em particular os Large Language Models (LLMs), está redefinindo a forma como interagimos com a tecnologia. Recentemente, uma nova abordagem tem ganhado destaque: tratar prompts de LLMs como programas de linha de comando (CLI). Essa técnica permite executar tarefas complexas de forma eficiente, integrando a capacidade de raciocínio dos LLMs diretamente no terminal, abrindo um leque de possibilidades para desenvolvedores e usuários avançados.

A Revolução do Prompt como Código

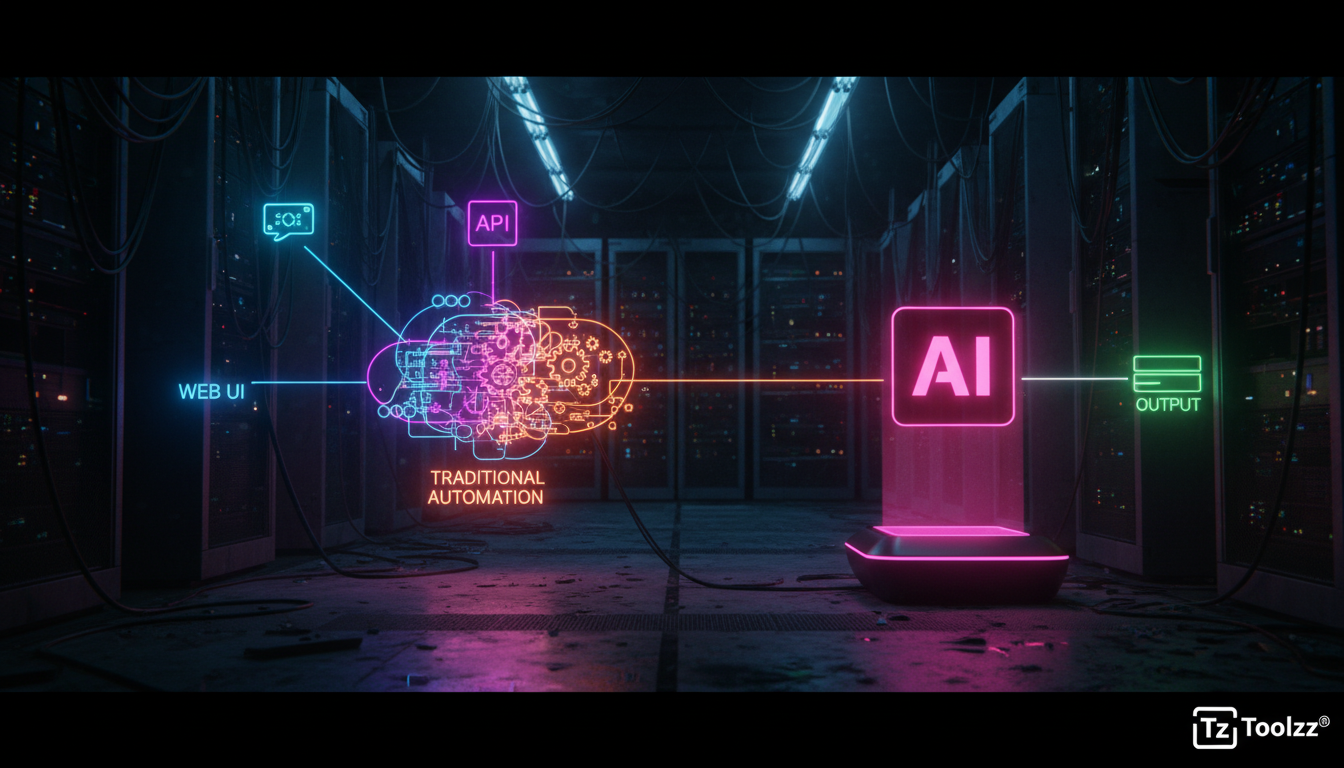

Tradicionalmente, os LLMs são acessados através de interfaces web ou APIs. No entanto, a capacidade de executá-los diretamente no terminal, como se fossem programas nativos, oferece uma série de vantagens. Isso inclui a integração com outras ferramentas de linha de comando, o uso de pipes para encadear comandos e a execução remota via SSH, sem a necessidade de instalar dependências ou gerenciar chaves de API no servidor remoto. A ideia central é transformar um prompt complexo em uma ferramenta reutilizável e automatizada.

Vantagens da Abordagem CLI

A utilização de LLMs como CLIs oferece benefícios significativos para a produtividade e automação. A capacidade de criar comandos personalizados com argumentos e flags permite adaptar o LLM para tarefas específicas. Por exemplo, é possível criar um comando para analisar logs, gerar documentação ou até mesmo realizar testes de segurança, tudo diretamente do terminal. A integração com pipes permite combinar o poder do LLM com outras ferramentas Unix, como grep, sed e awk, criando fluxos de trabalho complexos e automatizados. Além disso, a execução remota via SSH, sem a necessidade de instalar dependências no servidor, é um recurso poderoso para administradores de sistemas e desenvolvedores.

Quer experimentar o poder da IA no seu dia a dia?

Solicite uma demonstração da Toolzz AIImplementações e Ferramentas Existentes

Já existem ferramentas que facilitam a utilização de LLMs como CLIs. A ferramenta promptcmd, construída em Rust, permite definir prompts em arquivos com templates (estilo Handlebars), habilitá-los e executá-los como comandos nativos no terminal. Ela suporta múltiplos provedores de LLMs, balanceamento de carga entre eles, cache de respostas e a criação de variantes de modelos com prompts de sistema personalizados. A funcionalidade de SSH forwarding é particularmente interessante, pois permite executar os prompts localmente, mesmo que o servidor remoto não tenha acesso à internet ou chaves de API. Plataformas como a Toolzz AI também se encaixam nesse cenário, permitindo a criação de agentes de IA personalizados que podem ser integrados a fluxos de trabalho automatizados.

Casos de Uso Práticos

Aplicações práticas dessa abordagem são inúmeras. No desenvolvimento de software, um LLM pode ser usado para gerar código boilerplate, refatorar código existente ou até mesmo identificar vulnerabilidades de segurança. Na área de DevOps, um LLM pode ser usado para analisar logs, automatizar tarefas de configuração ou responder a incidentes de segurança. No atendimento ao cliente, um LLM pode ser usado para responder a perguntas frequentes, triar tickets de suporte ou até mesmo realizar diagnósticos de problemas técnicos. Imagine um agente de IA, como os oferecidos pela Toolzz AI, integrado à sua linha de comando, capaz de automatizar tarefas repetitivas e liberar sua equipe para atividades mais estratégicas.

Está buscando otimizar seu fluxo de trabalho com IA? Descubra como os Agentes de IA da Toolzz podem transformar sua produtividade.

Desafios e Considerações

Embora promissora, a utilização de LLMs como CLIs também apresenta alguns desafios. A latência da resposta do LLM pode ser um problema para aplicações que exigem tempo real. A necessidade de proteger as chaves de API e garantir a privacidade dos dados também é uma preocupação. A complexidade de criar prompts eficazes e garantir a consistência dos resultados requer um certo nível de expertise. Além disso, o custo de utilização de LLMs, especialmente para tarefas que exigem um alto volume de processamento, pode ser significativo. É importante considerar esses fatores ao avaliar a viabilidade de implementar essa abordagem em seus projetos.

O Futuro da Automação com LLMs

A transformação de prompts de LLMs em programas de linha de comando representa um passo importante na evolução da automação. Essa abordagem oferece uma nova forma de interagir com a inteligência artificial, permitindo integrar o poder dos LLMs diretamente em nossos fluxos de trabalho diários. Com o desenvolvimento de ferramentas mais sofisticadas e a redução dos custos de utilização, podemos esperar que essa tendência se torne cada vez mais popular nos próximos anos. A Toolzz LXP pode ser uma plataforma ideal para integrar esses novos fluxos de trabalho, oferecendo treinamento e recursos para que sua equipe possa aproveitar ao máximo o potencial dos LLMs.

Demonstração LXP

Experimente uma demonstração interativa da nossa plataforma LXP e descubra como podemos transformar o aprendizado na sua organização.