Acesso Descontrolado à IA: O Risco Invisível para Empresas

Descubra como o acesso excessivo de agentes de IA

Acesso Descontrolado à IA: O Risco Invisível para Empresas

17 de março de 2026

Com a rápida adoção de inteligência artificial, as empresas enfrentam um novo desafio de segurança: o acesso descontrolado de agentes de IA a dados sensíveis. A proliferação de contas de serviço, combinada com a complexidade das permissões em ambientes de nuvem, cria um cenário onde o risco se acumula silenciosamente, muitas vezes sem ser detectado pelas ferramentas de segurança tradicionais.

A Evolução do Shadow IT: Do Dropbox à IA

O conceito de Shadow IT não é novo. Inicialmente, referia-se ao uso de aplicativos e serviços não autorizados pelos funcionários. No entanto, com a ascensão da IA, o Shadow IT evoluiu para algo mais insidioso: o acesso não gerenciado e a ação autônoma de agentes de IA. Não se trata apenas de armazenamento de dados não autorizado, mas sim da capacidade desses agentes de acessar, processar e agir com informações confidenciais sem supervisão adequada.

Exemplos Práticos de Acesso Descontrolado

Em muitas organizações, é comum ver cenários como: uma integração de teste de um assistente de codificação IA que permanece ativa com acesso irrestrito ao repositório de código; um analista de negócios que automatiza tarefas com credenciais pessoais, criando um fluxo de trabalho que continua a rodar mesmo após sua saída da equipe; ou frameworks de agentes que armazenam chaves de API em logs de conversas. Esses casos, aparentemente inofensivos, podem abrir brechas significativas na segurança da empresa.

O problema é que esses acessos raramente aparecem nos painéis de gerenciamento de identidade e acesso (IAM). As políticas de prevenção de perda de dados (DLP) podem não identificar as atividades dos agentes de IA como anormais. O resultado é um risco crescente, muitas vezes invisível para as equipes de segurança.

Está preocupado com a segurança da sua IA?

Solicite uma demonstração da Toolzz AIO Problema das Identidades Não Humanas

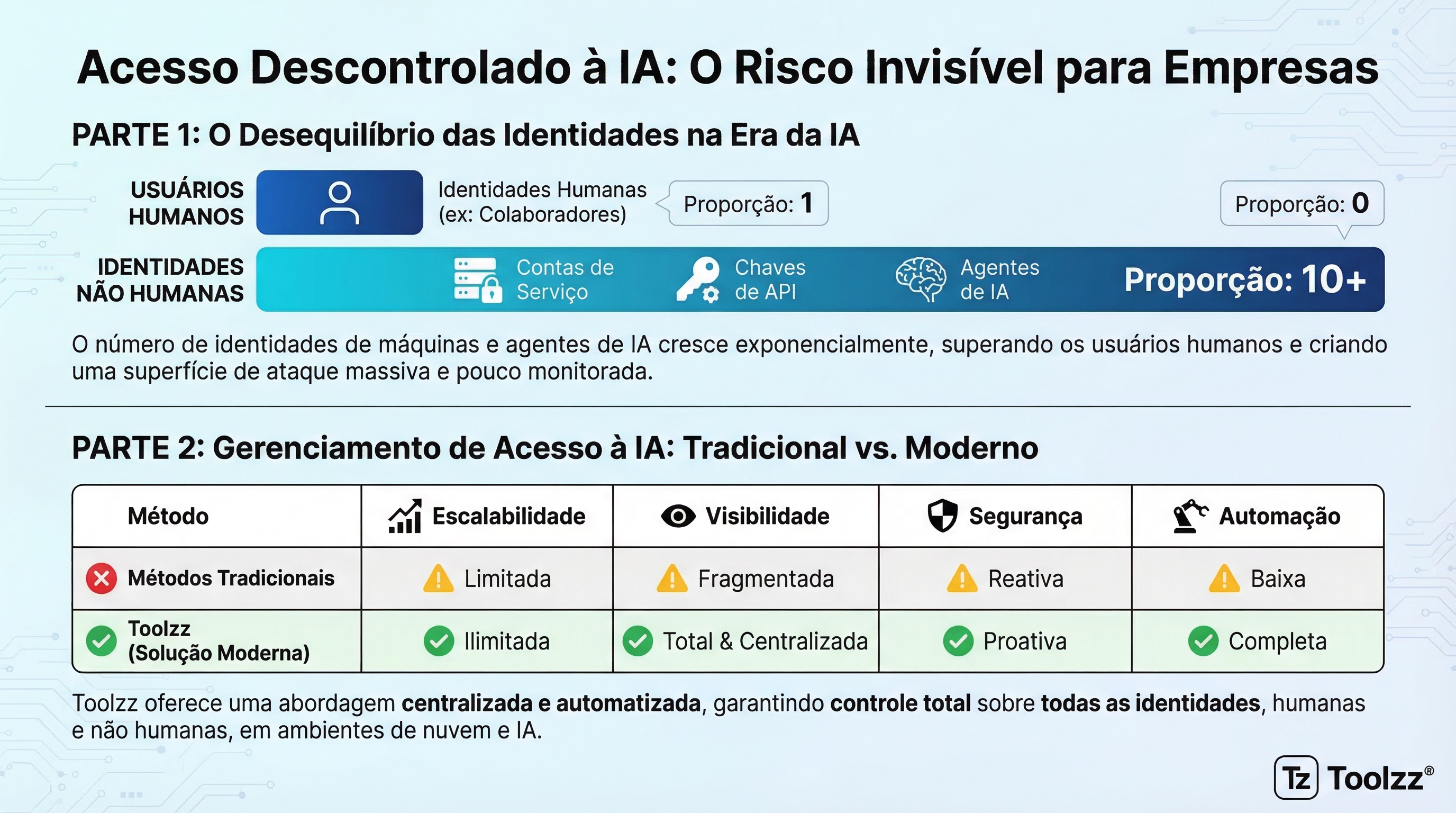

As identidades não humanas – contas de serviço, identidades de carga de trabalho, chaves de API e, cada vez mais, agentes de IA – já superam em número os usuários humanos na maioria das empresas, em uma proporção que pode chegar a 10:1. Gerenciar essas identidades é um desafio complexo, especialmente porque elas exigem um modelo de governança diferente do aplicado a usuários humanos. Ao contrário dos usuários, as identidades não humanas não precisam de senhas ou autenticação multifator, mas ainda assim precisam de acesso controlado e monitoramento constante.

Acesso como Plano de Controle para a Confiança em IA

A governança de acesso é fundamental para garantir a confiança na IA. Não basta garantir que os modelos de IA estejam alinhados com os valores da empresa e que a saída seja filtrada. É preciso controlar o que os agentes de IA podem realmente fazer, limitando seu acesso a dados e sistemas. A abordagem deve evoluir de “esta identidade está autorizada?” para “este padrão de acesso é consistente com o que esta identidade deve estar fazendo agora?”. Para garantir essa governança e controle, você pode conhecer as soluções da Toolzz AI.

Práticas para Implantação Responsável de Agentes de IA

Para mitigar os riscos associados ao acesso descontrolado de agentes de IA, é essencial adotar algumas práticas recomendadas:

- Escopo de permissões na implantação: Defina o acesso mínimo necessário para cada agente de IA realizar sua tarefa e bloqueie a implantação até que essas permissões sejam concedidas.

- Modelagem conjunta de identidades: Gerencie identidades humanas e não humanas de forma consistente, com as mesmas políticas e processos.

- Monitoramento contínuo: Estabeleça linhas de base de comportamento para cada agente e detecte anomalias que possam indicar acesso indevido ou comprometimento.

- Modelagem de acesso antes da implantação: Avalie o impacto de novas integrações e agentes de IA antes de colocá-los em produção.

Plataformas como a Toolzz AI oferecem recursos avançados para gestão de identidades e controle de acesso, permitindo que as empresas monitorem e restrinjam o acesso de seus agentes de IA em tempo real. Além disso, a Toolzz LXP pode auxiliar na conscientização e treinamento dos funcionários sobre as melhores práticas de segurança para IA.

Quer capacitar sua equipe para lidar com os desafios da IA? Explore os recursos da Toolzz LXP e promova uma cultura de segurança e aprendizado contínuo.

Conclusão

O acesso descontrolado de agentes de IA representa um risco crescente para a segurança empresarial. Ao adotar uma abordagem proativa e implementar as práticas recomendadas, as empresas podem reduzir significativamente sua exposição e garantir que a IA seja usada de forma responsável e segura. Ignorar este problema pode levar a violações de dados, perdas financeiras e danos à reputação. A segurança da IA não é apenas uma questão técnica, mas também uma responsabilidade de gestão.

Veja como é fácil criar sua IA

Clique na seta abaixo para começar uma demonstração interativa de como criar sua própria IA.